Regulació europea de la IA vs La regulació americana

Regulació europea de la IA planteja un xoc amb els EUA

La regulació europea de la IA ja ha entrat en vigor amb l’AI Act, la primera normativa mundial en intel·ligència artificial, però xoca frontalment amb un panorama als EUA cada cop més propici a la flexibilització reguladora. En definitiva, tenim dos models antagònics: Europa vol prevenir riscos; els Estats Units prefereixen prioritzar la innovació.

Què vol fer Europa?

Europa ha aprovat l’AI Act al març de 2024, i des d’agost entra en vigor la seva aplicació progressiva en sectors crítics i d’alt risc. D’aquesta manera, obliga a les empreses a fer auditoria, etiquetat, transparència i control de riscos per models d’IA que afectin salut, seguretat o drets fonamentals

A més, la Unió Europea ha establert multes de fins al 7 % de la facturació global per incompliments. També ha creat un codi de bones pràctiques voluntari per models generals, signat per OpenAI però rebut per Meta, que evita que la regulació es converteixi en una trampa legal per a pimes tecnològiques del continent.

També hem vist el pla InvestAI amb un fons de 200.000 milions d’euros per impulsar la sobirania tecnològica europea, incloent gigafactories i hardware propi, per compensar la dependència d’empreses nord-americanes i xineses.

No obstant això, malgrat aquesta aspiració normativa, segons experts com Mateo Valero, Europa segueix mancant d’autonomia en hardware i està massa enfocada en regular sense prioritzar el desenvolupament real de tecnologia local.

I als EUA què està passant?

En canvi, als Estats Units el panorama és radicalment diferent.

Des que Trump va tornar al poder l’any 2025, va derogar l’ordre executiva de Biden sobre supervisió de la IA. Això marca un gir cap a una relaxació legislativa, prioritzant l’ecosistema tecnològic pel damunt de la regulació estricta.

De fet, s’estan aprovant projectes com el “AI Action Plan” que promou menys restriccions, suport a datacenters i el desenvolupament ràpid d’infraestructura. Això porta el govern a rebutjar declaracions internacionals sobre IA inclusiva perquè les considera massa restrictives.

A més, s’ha intentat bloquejar la legislació estatal sobre IA durant deu anys, tot fumigant la capacitat dels estats d’aprovar regulacions més estrictes a nivell regional.

Europa diu “prou riscos”, els EUA diuen “prou frens”?

Clarament, hi ha un contrast en les prioritats. Europa prefereix un enfoc rigorós segons el nivell de risc: prohibeix alguns usos perillosíssims, regula amb detall les IA d’alt risc, i obliga a transparència en models generals. Això promou confiança ciutadana tot i que pugui frenar part de la innovació startup.

Els EUA, en canvi, tendeixen a limitar les regulacions als casos d’abús clar, deixant molt espai per al mercat i la tecnologia. Aquesta aposta planteja menys riscos legals, però pot generar deslocalització, desequilibri competitiu i una fractura entre ciutadans segons el lloc de residència.

Quin efecte tindrà en nosaltres?

Com et afecta això com a usuari o desenvolupador?

Primer, si vius a Europa, avisa als teus serveis d’IA si no compleixen la normativa. Si vius als EUA, potser tens accés prioritari a tecnologies com Gemini, ChatGPT, DALL·E… però també exposició a models menys regulats.

Segon, per a les empreses emergents europees, regularitzar-se pot ser un cost. Però també una oportunitat per diferenciar-se per transparència i ètica.

Tercer, a llarg termini això configura dues IA: la europea, centrada en confiança; i la americana, centrada en velocitat i escala. El gran interrogant és: què prefereixes? Què pactaran finalment en fòrums internacionals com el G7 o la cimera de París sobre IA?

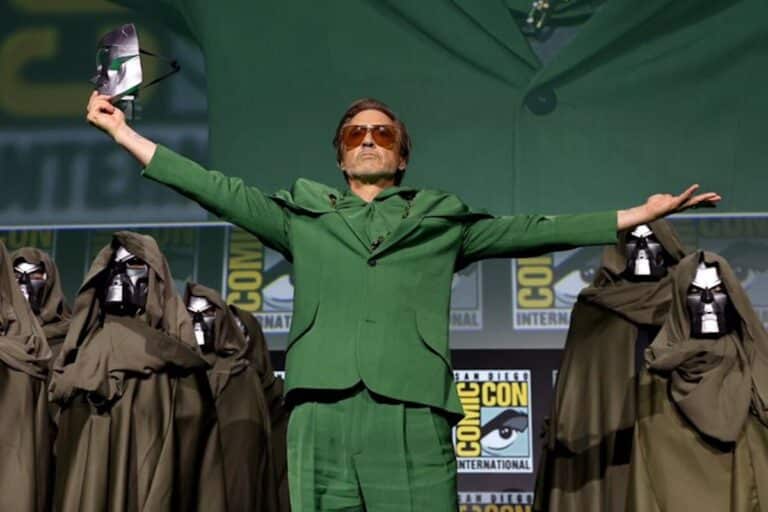

A Geeknorants ja ho hem tractat!

Però, aquesta notícia no és només normativa. També hem discutit aquest tema en dos episodis de Geeknorants: amb Cristian Cantón (director associat del Barcelona Supercomputing Center i exresponsable de Meta) i amb Gina Tost (exsecretària de polítiques digitals a la Generalitat).

Amb en Cantón vam tractar com la sobirania digital europea implica no només normes, sinó la necessitat de competir tecnològicament amb les plataformes nord-americanes. En canvi, la Gina Tost va aportar perspectives sobre com la Generalitat intenta implementar ètica digital i transparència en IA a nivell regional.

Creieu que Europa ha de ser més estricta? Preferiu un model més obert com el dels USA? Quins riscos són acceptables per no frenar la innovació? I sobretot, una cosa: creieu que les decisions de Brussel·les arribaran a temps per ser útils?

Dues velocitats, un futur per definir

En resum, Europa ha apostat per la regulació europea de la IA amb controls estrictes, mentre que els EUA prefereixen la relaxació normativa per accelerar el desenvolupament. Hi ha avantatges en cada model, però també riscos clars si no es troba un equilibri.

Finalment, les veus de Cantón i Tost són essencials per entendre com es pot implementar aquest debat a Catalunya i Europa. I tu, t’hi sumes a la conversa? Estem millorant o posant cadenes a la creativitat?